La triche par IA est devenue le casse-tête majeur de l'éducation moderne. Les étudiants utilisent ChatGPT pour rédiger des dissertations. Ils utilisent Wolfram Alpha pour résoudre des problèmes de mathématiques. Ils utilisent toutes sortes d'outils pour générer un travail qui ressemble au leur mais ne l'est pas. Et les enseignants sont épuisés.

La réponse standard a été la détection : logiciels anti-plagiat, détecteurs d'écriture IA, logiciels de surveillance. Mais la détection est une bataille perdue d'avance. Chaque nouvel outil de détection engendre de nouvelles techniques d'évasion. C'est une course aux armements sans fin en vue.

Et s'il existait une meilleure approche ? Et si, au lieu d'essayer de détecter le travail généré par IA, nous concevions des évaluations de manière à rendre l'IA non pertinente ?

C'est exactement ce dont je parlerai lors du webinaire de la communauté des praticiens de l'immersif de Pearson le jeudi 26 février 2026. Si vous êtes un éducateur britannique intéressé par la façon dont la technologie immersive peut transformer l'évaluation, j'aimerais beaucoup que vous nous rejoigniez.

Détails de l'événement

- Date : Jeudi 26 février 2026

- Heure : 15h30 à 17h00 (Royaume-Uni)

- Format : Webinaire en ligne avec questions-réponses

- Public : Éducateurs britanniques des écoles, collèges et enseignement supérieur

- Coût : Gratuit

Ce que nous aborderons

Le webinaire réunit les dernières recherches de Pearson sur l'IA générative et l'évaluation avec des perspectives pratiques de WhimsyLabs sur la mise en œuvre d'évaluations basées sur la RV dans de vraies salles de classe. La session comprend :

- Recherche de Pearson sur l'IA générative : Ce que les données nous révèlent sur l'impact de l'IA sur la validité de l'évaluation

- Meilleures pratiques pour l'évaluation en RV : Comment concevoir et mettre en œuvre des évaluations dans des environnements immersifs

- Discussion ouverte : Partagez vos expériences et défis avec d'autres éducateurs

Pourquoi l'évaluation axée sur le processus change tout

L'évaluation traditionnelle demande : « Qu'est-ce que l'étudiant a produit ? » Cela crée un problème fondamental à l'ère de l'IA. Si vous ne regardez que le résultat final, vous ne pouvez pas distinguer un étudiant qui comprend la matière de celui qui a utilisé ChatGPT efficacement.

L'évaluation axée sur le processus pose une question différente : « Qu'est-ce que l'étudiant a réellement fait ? »

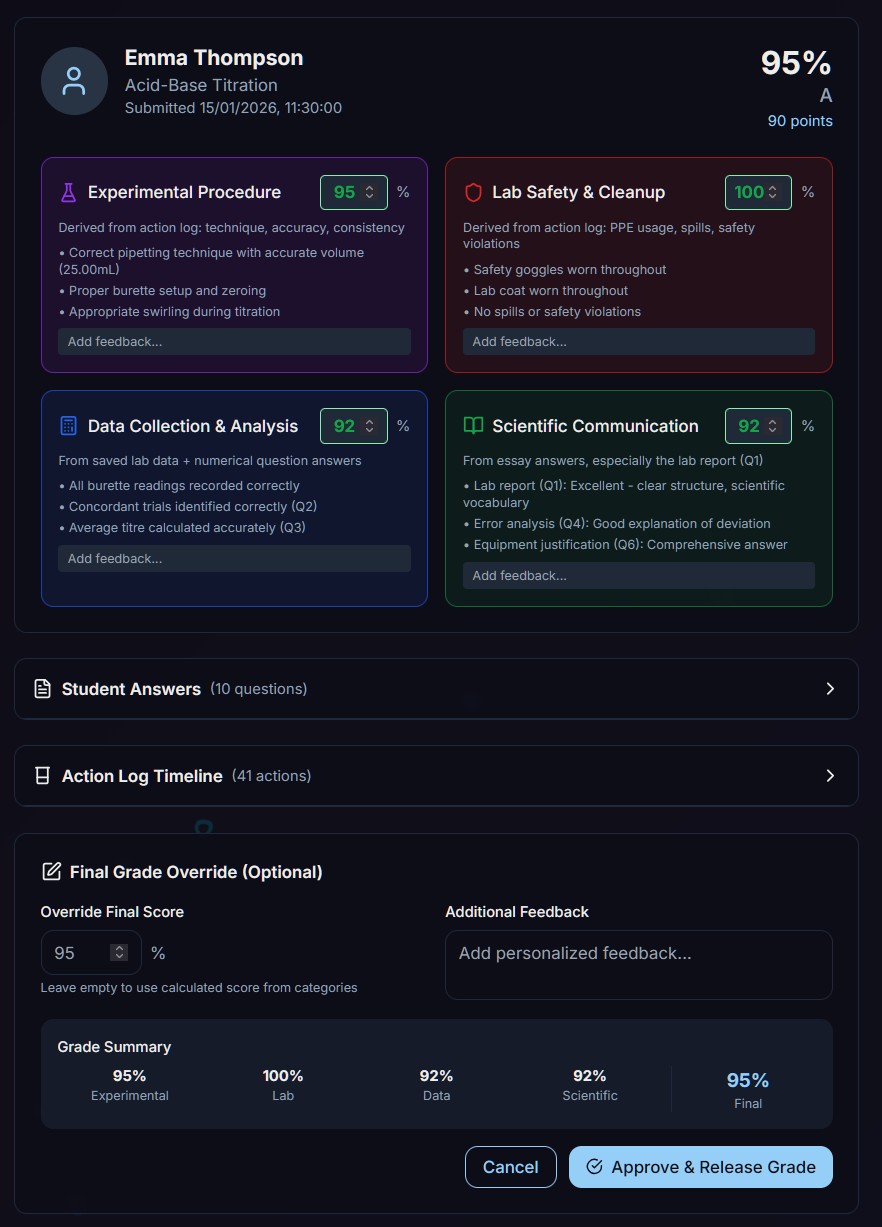

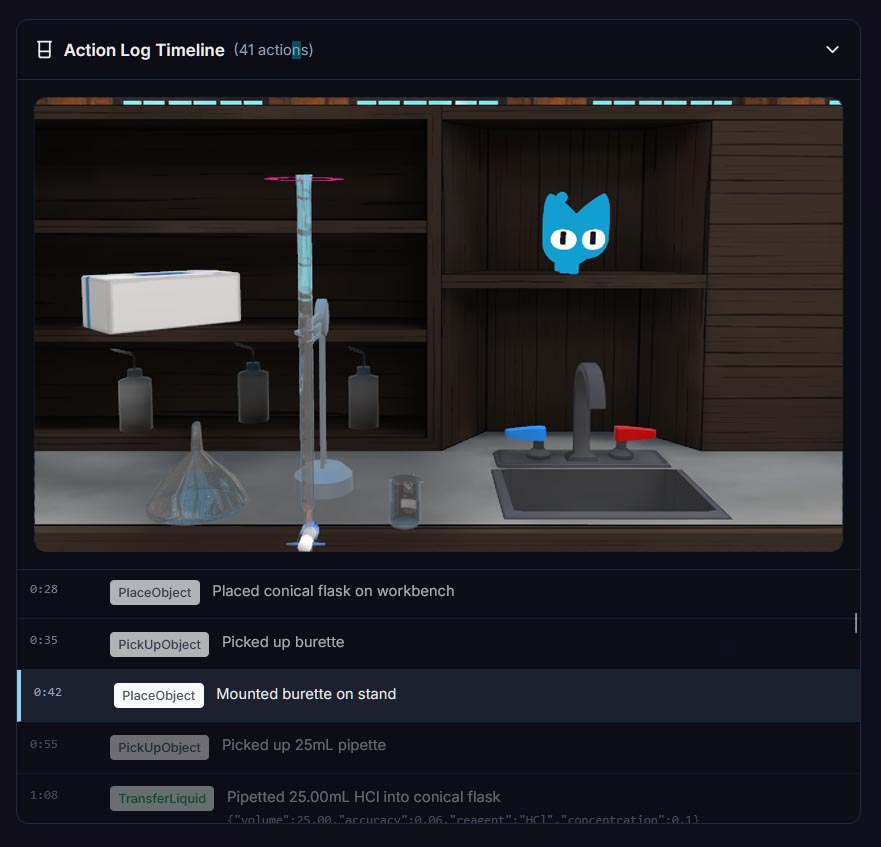

Dans un environnement de laboratoire virtuel, nous pouvons répondre à cette question avec précision. Lorsqu'un étudiant effectue un titrage dans WhimsyLabs, nous capturons tout : A-t-il rincé la burette avant de la remplir ? A-t-il ajouté l'indicateur dans l'erlenmeyer ? A-t-il approché le point d'équivalence lentement, en ajoutant les gouttes une par une ? A-t-il noté ses relevés avec précision ?

Il ne s'agit pas de surveillance. Il s'agit de capturer les compétences qui comptent vraiment dans l'enseignement des sciences. Un étudiant qui peut réciter les étapes d'un titrage n'a pas démontré sa compétence. Un étudiant qui peut effectuer un titrage correctement, avec une technique appropriée et une attention à la précision, a démontré une véritable capacité pratique.

La recherche derrière l'évaluation axée sur le processus

Ce n'est pas qu'une théorie. Un article récent dans Frontiers in Education (Alkouk & Khlaif, 2024) a exploré les évaluations résistantes à l'IA dans l'enseignement supérieur. L'idée clé : lorsque vous suivez les actions des étudiants plutôt que les résultats finaux, vous créez une évaluation naturellement robuste contre l'assistance de l'IA.

Pourquoi ? Parce que l'IA peut écrire sur les titrages. L'IA peut décrire les étapes. L'IA peut même générer des tableaux de données réalistes. Mais l'IA ne peut pas effectuer un titrage. Elle ne peut pas démontrer une technique appropriée. Elle ne peut pas montrer les connaissances procédurales qui viennent de la pratique.

Lorsque l'évaluation se concentre sur le processus, la question « ont-ils utilisé l'IA ? » devient moins pertinente. Ce qui compte, c'est : peuvent-ils faire la chose ?

Rendre l'IA non pertinente, pas invisible

Soyons clairs : l'objectif n'est pas d'interdire l'IA dans l'éducation. Les outils d'IA sont là pour rester, et les étudiants devraient apprendre à les utiliser efficacement. L'objectif est de concevoir des évaluations qui évaluent ce qui nous importe vraiment.

Dans l'enseignement des sciences, nous nous soucions de la compétence pratique. Nous voulons des étudiants capables de manipuler l'équipement en toute sécurité. Nous voulons des étudiants qui comprennent pourquoi chaque étape d'une procédure est importante. Nous voulons des étudiants capables de résoudre les problèmes quand les choses tournent mal.

Les laboratoires virtuels, avec leur visibilité complète du processus, nous permettent d'évaluer exactement ces compétences. Non pas à la place de l'évaluation traditionnelle, mais en complément. Le travail écrit a toujours sa place. Mais les compétences pratiques méritent une évaluation qui capture véritablement les capacités pratiques.

À quoi cela ressemble en pratique

Lors du webinaire, je partagerai des exemples concrets d'évaluation axée sur le processus en action :

- Notation de la technique : Comment l'IA de WhimsyLabs évalue la technique pratique en temps réel

- Suivi des compétences : Mesurer l'amélioration sur plusieurs tentatives, pas seulement la performance finale

- Analyse des erreurs : Comprendre où les étudiants rencontrent des difficultés et pourquoi

- Tableaux de bord enseignants : Donner aux éducateurs une visibilité sur le développement des compétences pratiques

Je discuterai également des défis que nous avons rencontrés et de la façon dont nous les avons surmontés. L'évaluation axée sur le processus n'est pas une solution miracle. Elle nécessite une mise en œuvre réfléchie et une communication claire avec les étudiants sur ce qui est évalué et pourquoi.

Qui devrait participer

Ce webinaire est conçu pour les éducateurs britanniques qui sont :

- Préoccupés par l'impact de l'IA sur la validité de l'évaluation

- Curieux de la technologie immersive dans l'éducation

- À la recherche d'approches pratiques pour une évaluation authentique

- Enseignants en sciences à tous les niveaux

- Impliqués dans la conception des programmes ou la politique d'évaluation

Aucune expérience préalable en RV ou en technologie immersive n'est requise. La session est conçue pour être accessible aux éducateurs de tous niveaux de familiarité technique.

Rejoignez la conversation

Le meilleur aspect de ces webinaires est la discussion. La communauté des praticiens de l'immersif de Pearson rassemble des éducateurs de tout le Royaume-Uni qui réfléchissent sérieusement à la façon dont la technologie peut servir l'apprentissage. La session de questions-réponses est toujours riche en idées et en questions pratiques.

J'ai hâte d'entendre quels défis vous rencontrez et quelles solutions vous avez trouvées. L'évaluation à l'ère de l'IA est un problème que nous naviguons tous ensemble, et les meilleures idées viennent souvent des praticiens sur le terrain.

Inscrivez-vous maintenant

Le webinaire est gratuit, mais l'inscription est obligatoire. Les places peuvent être limitées, je vous encourage donc à vous inscrire tôt si vous êtes intéressé.

J'espère vous y voir. Et si vous ne pouvez pas y assister mais souhaitez en savoir plus sur l'évaluation axée sur le processus dans les laboratoires virtuels, n'hésitez pas à nous contacter directement. Nous sommes toujours heureux de discuter de la façon dont WhimsyLabs peut soutenir l'évaluation authentique dans votre école ou établissement.

Références

- Alkouk, W.A., & Khlaif, Z.N. (2024). AI-resistant assessments in higher education: practical insights from faculty training workshops. Frontiers in Education, 9, 1499495. https://doi.org/10.3389/feduc.2024.1499495

- Pearson (2025). Assessment Evolved: Redefining Formative Assessment in a Generative AI Era. Pearson Insights