2025年12月、Pearsonは教育に携わる誰もが驚かなかった発見を発表しました:教育者の82%が、学生がGenAIを使って課題を完成させることを懸念しています。機関の対応は予測可能でした。検出ツール、監視ソフトウェア、そしてAIを捕まえて罰するべきものとして扱うポリシー。

ChatGPTの広範な使用から2年、その効果がどれほどかがわかります。検出ツールは学生との信頼を破壊する偽陽性を生み出します。ポリシーは機関間はもちろん、部門間でも大きく異なります。教育者の推定よりもはるかに高い割合でAIを使用している学生たちは、単にそれを隠すのが上手くなっただけです。

しかし、Pearsonの研究はより根本的なことを指摘しています。リスクは実際には不正ではありません。リスクは、学生が学習を可能にする認知的作業をスキップすることです。学生がChatGPTにラボレポートを書かせると、単に課題で不正をしただけではありません。その課題が生み出すはずだった思考を逃しているのです。

WhimsyLabsでは、異なるアプローチをとってきました。AI使用をどう検出するかを問うのではなく、AIが単純に助けられない評価をどう設計するかを問いました。

検出が失敗する理由

AI検出ツールは、機械生成テキストを高精度で識別できると主張しています。現実はもっと複雑です。これらのツールは、特に学生がプロンプトでより洗練されるにつれて、AI文章と人間の文章を区別するのに苦労します。また、偽陽性も生み出し、学生が本当に自分で書いた作品をフラグ付けすることもあります。AI不正を誤って告発された学生にとって、機関との関係へのダメージは永続的なものになり得ます。

Macquarie大学で苦情と不正行為を担当するKane Murdochは、Pearsonのレポートでこう述べています:「検出器の問題は、何の証拠も生成しないことです...誰かが検出器が提供した数字を見ると、その後のすべてのプロセスでバイアスがかかります。」

精度の問題を超えて、検出は敵対的なダイナミクスを生み出します。学生は潔白が証明されるまで不正をしていると仮定します。実際の教育に使えるはずの時間とエネルギーを消費します。そして、学生が実際に学んでいるかという根本的な問題には何も対処しません。

成果物ではなくプロセスを評価する

学生が何を生み出すかだけでなく、どのように取り組むかを評価することを検討してください。

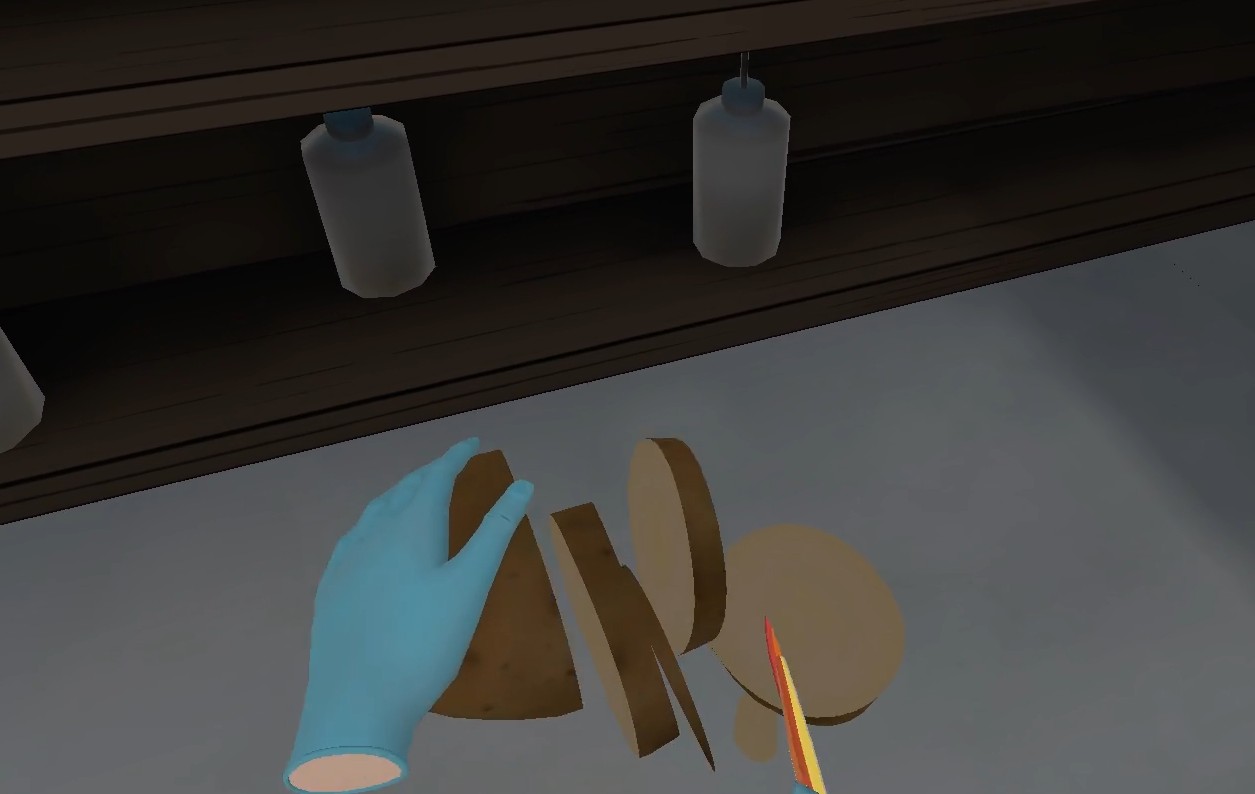

これがWhimsyLabsに組み込んだアプローチです。私たちのバーチャルラボは、学生に実験を行わせるだけではありません。すべてのアクションについて詳細なデータを取得します:学生がどれほど正確にピペッティングするか、エンドポイントを正しく検出するか、機器をどう扱うか、安全プロトコルに従っているか。

このデータは、従来の評価ではできないことを可能にします:手順的能力を直接評価すること。学生に滴定をどう行うか説明させるのではありません。私たちは彼らがそれを行うのを見ます。精度を測定します。ビュレットから気泡を除去するかを見ます。エンドポイントを超えるかどうかがわかります。

ChatGPTは学生のためにバーチャル滴定を行うことができません。偽造するものがないので、検出するものもありません。

私たちが測定するもの

学生がバーチャル実験を完了すると、最終回答だけを記録するのではありません。複数の次元で証拠を収集します:

- 精度: 試行間で測定値は一貫していましたか?(±0.02 mLか±0.5 mLか?)

- テクニック: スムーズなコック操作?フラスコの正しい旋回?

- タイミング: エンドポイントをどれくらい早く認識しましたか?セットアップにどれくらい時間がかかりましたか?

- 安全性: 適切なPPE?正しい化学物質の取り扱いと廃棄?

- 問題解決: 結果が予想外だったとき、どう対応しましたか?

Pearsonはこれを「より豊富な形式の証拠」と呼んでいます。従来の評価ではこの種のデータを収集することはできません。AI問題にとってさらに重要なのは、この証拠は学生が実際に作業を行ったことを必要とするということです。

学生の不正ではなく、教師を助けるAI

AI評価問題に対する私たちの解決策は実際にAIを含みますが、異なる役割で。学生が学習をスキップするのを助けるのではなく、教師が学習を評価するのを助けるためにAIを使用します。

学生がバーチャル実験を完了すると、私たちのシステムはアクションログと実験データを分析します。5つの次元で成績を提案します:実験手順、データ収集、計算、ラボの安全性、科学的コミュニケーション。各提案には信頼度レベル(75-98%)が含まれ、AI評価が信頼できる場所と人間の判断がより重要な場所を教師に示します。教師は最終成績をレビュー、調整、承認します。AIは時間のかかる分析を処理します。人間が判断を下します。

これはPearsonの専門家パネルが推奨することと一致しています:教育者がコントロールを維持することを確保しながら、AIを「形成的評価のための力の乗数」として使用すること。

なぜ実践的評価はAIのショートカットに耐えるのか

Pearsonの研究は、どの評価タイプがAIの悪用に最も脆弱かを教育者に尋ねました。結果は驚くべきものではありませんでした。エッセイ、コーディング課題、多肢選択問題が最も脆弱とランク付けされました。シミュレーションとゲームベースのアクティビティは最も脆弱でないとランク付けされました。

これは理にかなっています。ChatGPTに化学について書かせることはできます。化学を行わせることはできません。実践的な作業の物理的性質は、テキストベースのAIが超えられない障壁を作ります。

科学教育にとって、これは実際には良いニュースです。実践的な作業を必要とする科目は、まさにAIのショートカットが失敗する科目です。技術と戦う必要はありません。科学教育をエッセイライティングとは異なるものにする要素を強調する必要があります。

本当の問題

AI for EducationのCEO、Amanda Bickerstaffは、Pearsonのレポートで核心的な懸念を特定しています:

「学術的誠実性の違反が今とても恐ろしい深い理由は、子供たちが教育の役割、学習の役割を軽視し始めるかもしれないという恐れです。」

検出と罰則はそれを修正しません。教育がまだ重要であることを示すことが修正します。そしてそれを行う方法は、実際に学習が必要なことを評価することです。

正確に滴定を物理的に行う能力で学生を評価するとき、ショートカットはありません。実験中の予期しない結果への対応で採点するとき、AIは助けられません。リアルタイムでテクニック、タイミング、安全コンプライアンスを評価するとき、評価は学習と切り離せなくなります。

前進する

AI評価問題の解決策は、より多くの監視やより厳格なポリシーではないと考えています。それはより良い評価設計です。スキルの本物の実証を必要とし、学習の豊富な証拠を収集し、AIを使用して人間の判断を置き換えるのではなく強化する評価。

これは書面評価を放棄することを意味しません。しかし、その限界を認識し、書くことでは捉えられないものを捉える方法で補完することを意味します:手順的知識、テクニック、プレッシャーの下で実行し、物事がうまくいかないときに適応する能力。

WhimsyLabsでは、それを可能にするツールを構築しています。なぜなら、評価の未来は不正行為者を捕まえることではないからです。正直に行う価値のある学習体験を設計することです。

これを実際に見ることに興味がありますか?お問い合わせください、WhimsyLabsがあなたの学校の実践的な科学評価をどのように改善できるかを学んでください。

出典: