En diciembre de 2025, Pearson publicó un hallazgo que no sorprendió a nadie en el sector educativo: el 82% de los educadores están preocupados porque los estudiantes usan GenAI para completar tareas. La respuesta institucional ha sido predecible: herramientas de detección, software de vigilancia y políticas que tratan la IA como algo que hay que atrapar y castigar.

Dos años después del uso generalizado de ChatGPT, podemos ver qué tan bien está funcionando eso. Las herramientas de detección producen falsos positivos que destruyen la confianza con los estudiantes. Las políticas difieren drásticamente entre departamentos, y no digamos entre instituciones. Los estudiantes, que usan IA a tasas mucho más altas de lo que los educadores estiman, simplemente se han vuelto mejores ocultándolo.

Sin embargo, la investigación de Pearson señala algo más fundamental. El riesgo no es realmente el engaño. El riesgo es que los estudiantes se salten el trabajo cognitivo que hace posible el aprendizaje. Cuando un estudiante hace que ChatGPT escriba su informe de laboratorio, no solo ha hecho trampa en una tarea. Ha perdido el pensamiento que la tarea debía producir.

En WhimsyLabs, hemos abordado esto de manera diferente. En lugar de preguntar cómo detectar el uso de IA, preguntamos cómo diseñar evaluaciones donde la IA simplemente no puede ayudar.

Por qué la detección falla

Las herramientas de detección de IA afirman identificar texto generado por máquinas con alta precisión. La realidad es más complicada. Estas herramientas tienen dificultades para distinguir la escritura de IA de la escritura humana, especialmente a medida que los estudiantes se vuelven más sofisticados con los prompts. También producen falsos positivos, a veces marcando trabajos que los estudiantes realmente escribieron ellos mismos. Para un estudiante acusado falsamente de hacer trampa con IA, el daño a su relación con la institución puede ser permanente.

Kane Murdoch, quien maneja quejas y mala conducta en la Universidad Macquarie, lo expresa bien en el informe de Pearson: "El problema con los detectores es que no generan ninguna evidencia... Una vez que alguien ve ese número proporcionado por el detector, estará sesgado durante todo el proceso posterior."

Más allá de los problemas de precisión, la detección crea una dinámica adversarial. Asume que los estudiantes están haciendo trampa hasta que se demuestre lo contrario. Consume tiempo y energía que podrían destinarse a la enseñanza real. Y no hace nada para abordar el problema subyacente de si los estudiantes realmente están aprendiendo.

Evaluar el proceso en lugar del producto

Considere evaluar cómo trabajan los estudiantes en lugar de solo lo que producen.

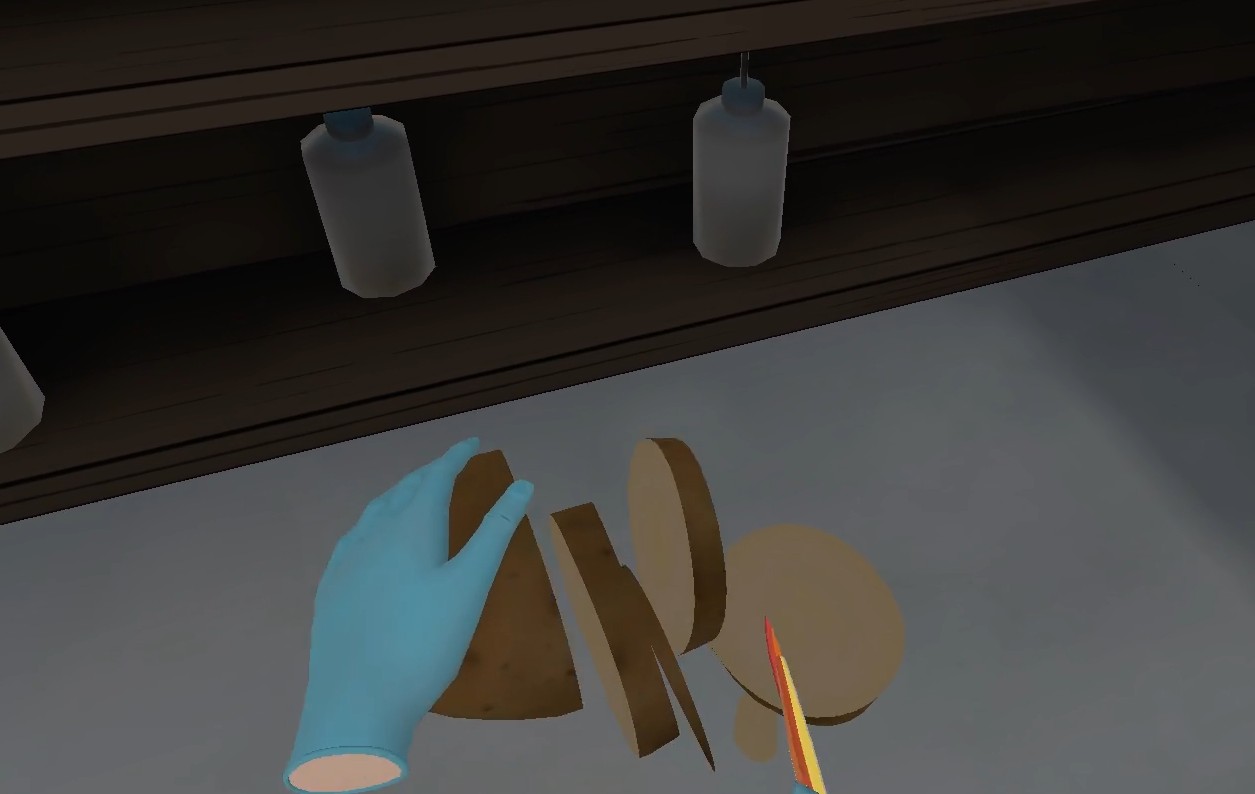

Este es el enfoque que hemos incorporado en WhimsyLabs. Nuestros laboratorios virtuales no solo permiten a los estudiantes realizar experimentos. Capturan datos detallados sobre cada acción: con qué precisión pipetean los estudiantes, si detectan correctamente los puntos finales, cómo manejan el equipo, si siguen los protocolos de seguridad.

Estos datos permiten algo que la evaluación tradicional no puede hacer: evaluar la competencia procedimental directamente. No pedimos a los estudiantes que describan cómo realizarían una titulación. Los observamos hacerlo. Medimos su precisión. Vemos si eliminan las burbujas de aire de la bureta. Sabemos si sobrepasan el punto final.

ChatGPT no puede realizar una titulación virtual por un estudiante. No hay nada que detectar porque no hay nada que falsificar.

Qué medimos

Cuando un estudiante completa un experimento virtual, no solo registramos su respuesta final. Capturamos evidencia en múltiples dimensiones:

- Precisión: ¿Fueron las mediciones consistentes entre ensayos? (±0,02 mL o ±0,5 mL?)

- Técnica: ¿Control suave de la llave? ¿Agitación correcta del matraz?

- Temporización: ¿Qué tan rápido reconocieron el punto final? ¿Cuánto tiempo llevó la preparación?

- Seguridad: ¿EPP adecuado? ¿Manejo y eliminación correctos de químicos?

- Resolución de problemas: ¿Cómo respondieron cuando los resultados fueron inesperados?

Pearson llama a esto "formas más ricas de evidencia". Las evaluaciones tradicionales simplemente no pueden capturar este tipo de datos. Más importante aún para el problema de la IA, esta evidencia requiere que el estudiante haya realizado realmente el trabajo.

IA que ayuda a los profesores, no a los estudiantes a hacer trampa

Nuestra solución al problema de evaluación con IA sí involucra IA, pero en un rol diferente. En lugar de ayudar a los estudiantes a saltarse el aprendizaje, usamos IA para ayudar a los profesores a evaluar el aprendizaje.

Cuando un estudiante completa un experimento virtual, nuestro sistema analiza su registro de acciones y datos experimentales. Sugiere calificaciones en cinco dimensiones: procedimiento experimental, recolección de datos, cálculos, seguridad de laboratorio y comunicación científica. Cada sugerencia incluye un nivel de confianza (75-98%), mostrando a los profesores dónde la evaluación por IA es confiable y dónde el juicio humano importa más. Los profesores revisan, ajustan y aprueban las calificaciones finales. La IA maneja el análisis que consume tiempo. El humano toma las decisiones de criterio.

Esto se alinea con lo que el panel de expertos de Pearson recomienda: usar la IA como un "multiplicador de fuerza para la evaluación formativa" mientras se asegura que los educadores mantengan el control.

Por qué la evaluación práctica resiste los atajos de IA

La investigación de Pearson preguntó a los educadores qué tipos de evaluación eran más vulnerables al mal uso de IA. Los resultados no fueron sorprendentes. Los ensayos, las tareas de programación y las preguntas de opción múltiple se clasificaron como los más vulnerables. Las simulaciones y actividades basadas en juegos se clasificaron como las menos vulnerables.

Esto tiene sentido. Puedes pedirle a ChatGPT que escriba sobre química. No puedes pedirle que haga química. La naturaleza física del trabajo práctico crea una barrera que la IA basada en texto no puede cruzar.

Para la educación científica, estas son buenas noticias. Las materias que requieren trabajo práctico son exactamente las materias donde los atajos de IA fallan. No necesitamos luchar contra la tecnología. Necesitamos enfocarnos en lo que hace diferente a la educación científica de escribir ensayos.

El problema real

Amanda Bickerstaff, CEO de AI for Education, identifica la preocupación central en el informe de Pearson:

"La razón más profunda por la que las violaciones de integridad académica son tan aterradoras ahora mismo es el miedo a que los niños empiecen a devaluar el rol de la educación, el rol del aprendizaje."

La detección y el castigo no arreglarán eso. Demostrar que la educación todavía importa sí lo hará. Y la forma de hacerlo es evaluando las cosas que realmente requieren aprendizaje para ser demostradas.

Cuando evaluamos a los estudiantes por su capacidad de realizar físicamente una titulación con precisión, no hay atajo. Cuando los calificamos por cómo manejan resultados inesperados durante un experimento, la IA no puede ayudar. Cuando evaluamos su técnica, temporización y cumplimiento de seguridad en tiempo real, la evaluación se vuelve inseparable del aprendizaje.

Avanzando

Creemos que la solución al problema de evaluación con IA no es más vigilancia ni políticas más estrictas. Es mejor diseño de evaluación. Evaluaciones que requieran demostración auténtica de habilidades, capturen evidencia rica del aprendizaje y usen IA para mejorar el juicio humano en lugar de reemplazarlo.

Esto no significa abandonar las evaluaciones escritas. Pero sí significa reconocer sus limitaciones y complementarlas con métodos que capturen lo que la escritura no puede: conocimiento procedimental, técnica, la capacidad de desempeñarse bajo presión y adaptarse cuando las cosas salen mal.

En WhimsyLabs, estamos construyendo herramientas para hacer eso posible. Porque el futuro de la evaluación no se trata de atrapar tramposos. Se trata de diseñar experiencias de aprendizaje que valga la pena hacer honestamente.

¿Interesado en ver esto en acción? Contáctenos para saber cómo WhimsyLabs puede mejorar la evaluación práctica de ciencias en su escuela.

Fuentes: